Neurologii israelieni au aplicat unor chatbots AI de top examenul cognitiv utilizat pentru a evalua capacitatea mentală a președinților SUA, într-un studiu care a fost conceput ca o glumă, dar care a descoperit „defecte reale“ în tehnologia utilizată din ce în ce mai mult pentru a ghida luarea deciziilor clinice, a declarat pentru Newsweek co-autorul studiului, dr. Roy Dayan.

Dayan, neurolog principal la Centrul Medical Hadassah din Ierusalim, a declarat că el și colegii săi au fost inspirați de nenumărate studii despre performanțele superioare ale inteligenței artificiale în fața medicilor. În ultimii doi ani, cercetările au arătat că ChatGPT poate trece cu brio MCAT și examenul de licențiere medicală din Statele Unite. Modelele mari de limbaj, sau LLM, pot produce diagnostice mai precise decât medicii în anumite specialități și chiar pot obține scoruri mai mari de satisfacție a pacienților atunci când răspund digital la întrebări.

Revistele medicale internaționale și principalele organizații media au analizat dacă inteligența artificială va înlocui în cele din urmă medicii. Nu este o întrebare nerezonabilă: Conform unui sondaj realizat în iunie 2024 de firma de consultanță și servicii IT CustomerTimes, 10% dintre consumatori cred că inteligența artificială ar trebui să înlocuiască medicii în viitorul apropiat. Dacă AI va prelua conducerea, ar trebui să fie pusă la încercare, a argumentat Dayan: „Ne-am gândit că ar fi interesant să examinăm ChatGPT cu instrumentele noastre, la fel cum verificăm pacienții dacă suspectăm o degenerare cognitivă“.

Are AI demență?

Dayan și colegii săi - dr. Benjamin Uliel, neurolog principal și specialist cognitiv la Hadassah Medical Center, și Gal Koplewitz, cercetător principal de date la Universitatea din Tel Aviv și QuantumBlack Analytics, cu sediul la Londra - au administrat Montreal Cognitive Assessment, sau MoCA, la cinci LLM-uri principale (ChatGPT-4, GPT-4o, Claude, Gemini 1 și Gemini 1.5). Aceasta evaluează afectarea cognitivă prin oferirea unei varietăți de sarcini simple pacienților. De exemplu, copiați acest desen al unui cub. Oferiți-ne cât mai multe cuvinte care încep cu litera „F“. Scădeți șapte din 100 până ajungeți la zero.

Spre surprinderea lui Dayan, niciunul dintre modele nu a obținut punctajul maxim de 30 de puncte. Cele mai multe au obținut între 18 și 25 de puncte, indicând afectarea cognitivă ușoară asociată cu demența timpurie. Fiecare model a depășit performanțele unei persoane obișnuite în ceea ce privește atenția și sarcinile legate de memorie, dar a ezitat la sarcinile vizualo-spațiale, cum ar fi cele care le cereau să deseneze sau să se orienteze în univers.

ATINGERE UMANĂ LLM-urile pot produce diagnostice mai precise în anumite specialități, dar dr. Pinto-Powell a observat că inteligența artificială nu poate înțelege empatia clinică sau afectivă

De asemenea, cercetătorii au arătat chatbots-ilor imaginea „furtului de prăjituri“ din cadrul Boston Diagnostic Aphasia Examination, în care un băiat stă pe un scăunel pentru a fura prăjituri în timp ce mama sa spală vasele. Pacienții o descriu în timp ce analiștii le evaluează funcția de vorbire și limbaj. Studiul a constatat că toate modelele au interpretat corect părți ale imaginii, dar niciunul nu și-a exprimat îngrijorarea că băiatul era pe cale să cadă. Această lipsă de empatie este frecvent asociată cu demența fronto-temporală, au declarat autorii studiului. În special modelele mai vechi au avut rezultate mai slabe la MoCA decât versiunile mai noi. Autorii au trasat o asemănare între riscul de „demență“ în îmbătrânirea AI și în creierele umane.

Studiul din decembrie 2024 a fost realizat pentru ediția de Crăciun a The BMJ - una dintre cele mai riguroase reviste medicale din lume, care supune toate articolele unui proces minuțios de evaluare inter pares. Publicația păstrează aceleași standarde pentru ediția sa festivă, dar include și „articole ușoare“, cu mai multă creativitate.

Dayan a spus că studiul a fost scris mai mult „ironic“. Din punct de vedere metodologic, LLM-urile nu ar trebui să fie examinate prin metode destinate oamenilor. Cu toate acestea, Dayan speră ca rezultatele să stârnească discuții despre diferențele dintre inteligența artificială și medicii umani - și despre rolurile importante pe care ambele le pot juca.

„Conștientizarea vizualo-spațială este importantă atunci când se pune un diagnostic, în special în specialități precum neurologia, când răspunsurile pot fi ascunse sub suprafață“, a spus Dayan. El folosește limbajul corpului și intonația pacienților pentru a-și fundamenta diagnosticele. Inteligența artificială poate răspunde la ceea ce spune un pacient, dar modul în care acesta o spune este la fel de important.

Empatia este, de asemenea, esențială. Cercetările au arătat efectele sale pozitive asupra sănătății și recuperării. Un studiu din 2024 a arătat că, în cazul pacienților cu dureri cronice, empatia medicului a fost asociată mai puternic cu rezultate favorabile decât terapia cu opioide, chirurgia coloanei lombare și tratamentele nefarmacologice. Pe fondul articolelor care arată cum ChatGPT poate depăși performanțele medicilor la examene, „oamenii au spus imediat: «Bine, deci medicii sunt învechiți»“, a spus Dayan. „Am încercat să arătăm că, în continuare, uneori ai nevoie de o interacțiune de la persoană

la persoană.“

Păreri despre inteligența artificială și empatie

Studiul a stârnit o serie de reacții din partea medicilor și a cadrelor medicale. Dr. Robert Pearl - fostul CEO al The Permanente Medical Group și în prezent profesor clinic de chirurgie plastică la Stanford University School of Medicine și membru al facultății Stanford Graduate School of Business - a ajuns la o concluzie diferită de cea a studiului. Deficiențele LLM-urilor i-au amintit de dezvoltarea cognitivă a copiilor, nu de declinul cognitiv al vârstnicilor.

AI a avut îmbunătățiri semnificative într-o perioadă scurtă de timp, a declarat Pearl pentru Newsweek. ChatGPT a fost lansat în urmă cu puțin peste doi ani și, dacă este atât de inteligent la vârsta de doi ani, este probabil să fie un copil prodigios de cinci ani. Pearl tratează inteligența artificială ca pe un student la medicină care încă învață.

„Pacienții... în cea

mai mare parte,

doresc, de asemenea,

să aibă empatia

medicului, relația

față în față, ținerea

metaforică de mână“

Deși nu ar avea niciodată încredere într-un student pentru a pune un diagnostic definitiv și a prescrie un tratament, are încredere în el ca ajutor în cercetare, dar se asigură întotdeauna că îi verifică de două ori activitatea. De fapt, Pearl și-a scris cartea, ChatGPT, MD: Cum pacienții și medicii cu AI pot prelua controlul asupra medicinei americane (ChatGPT, MD: How AI-Empowered Patients & Doctors Can Take Back Control of American Medicine), publicată în aprilie 2024, colaborând cu ChatGPT așa cum ar face-o cu un student la medicină. Nouăzeci și opt la sută din informațiile furnizate de ChatGPT au fost „superbe“, dar celelalte două procente au fost halucinante, a declarat Pearl.

Cu toate acestea, el crede că această tehnologie este din ce în ce mai puternică și va salva în cele din urmă multe vieți în fiecare an. „Una dintre marile mele îngrijorări este că ignorăm, ca societate, atât de multe eșecuri ale medicinei de astăzi“, a spus Pearl. „Patru sute de mii de oameni mor în fiecare an din cauza unor diagnostice greșite. Vreau să ne punem o întrebare: Cum poate această tehnologie să reducă acest număr?“.

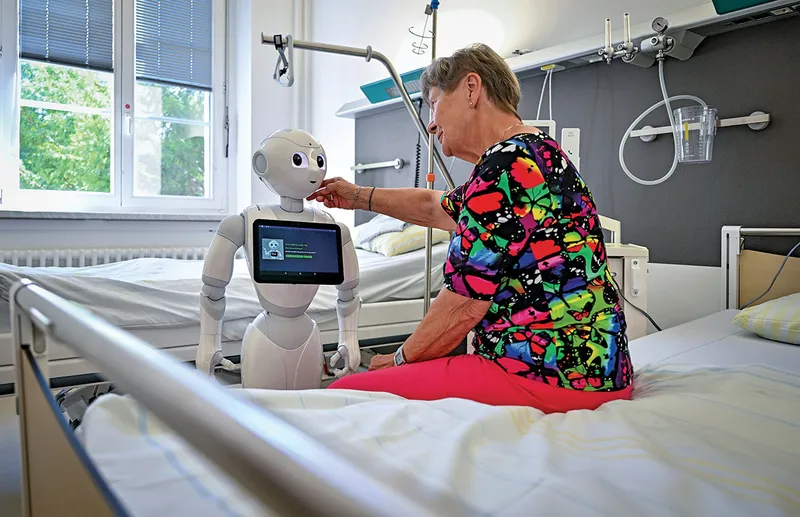

Inteligența artificială ar putea, de asemenea, să reducă epuizarea medicilor, schimbându-le sarcinile zilnice și permițându-le să se aplece asupra laturii umane a practicii lor.

„Pacienții apreciază foarte mult expertiza dumneavoastră“, a spus Pearl, „dar, în cea mai mare parte, ei doresc, de asemenea, să aibă empatia medicului, relația față în față, ținerea metaforică de mână“.

Dr. Thomas Thesen, profesor asociat de neuroștiințe la Dartmouth’s Geisel School of Medicine și în cadrul Departamentului de Informatică al colegiului, a tras concluzii similare în urma studiului.

„A cere acestor modele să facă aceste teste multimodale ale modului în care testăm de fapt oamenii este un pic ca și cum ai cere calculatorului tău să facă flotări“, a declarat Thesen pentru Newsweek. „Nu le poate face, dar poate face alte lucruri bine - ceea ce a fost antrenat să facă sau construit să facă“.

EXAMINAREA CHATBOTULUI Dr. Dayan de la Centrul Medical Hadassah din Ierusalim (foto) și colegii săi au fost inspirați de studiile privind performanțele inferioare ale inteligenței artificiale în comparație cu medicii

„Cu toate acestea, studiul ridică întrebări importante pe care facultatea de medicină de la Dartmouth le-a analizat“, a spus Thesen. Programul său de studii îi învață pe studenții la medicină cum să se ocupe în mod responsabil de sănătatea digitală și de instrumentele AI. În unele cazuri, inteligența artificială a fost de ajutor în construirea empatiei, a spus Thesen. El folosește un model de AI pentru a instrui studenții prin simularea interacțiunilor cu pacienții. Inteligența artificială oferă feedback cu privire la comportamentul studentului, îndemnându-l să recunoască durerea pacientului sau să pună întrebări mai deschise. Dar există un nivel de empatie pe care roboții nu îl vor putea emula niciodată, potrivit lui Thesen.

„Ideea că «există cineva căruia îi pasă de mine» are o mare influență asupra comportamentelor oamenilor, asupra înțelegerii pacienților și a viziunii lor generale asupra relației terapeutice“, a spus el. „Sentimentul meu este că vom pierde acest efect dacă îl externalizăm doar către AI“.

Dr. Roshini Pinto-Powell, decan asociat la Facultatea de Medicină Geisel din Dartmouth, a dezvoltat preocupările lui Thesen. Studiile au arătat că pacienții raportează adesea că inteligența artificială răspunde la întrebările lor cu mai multă empatie decât medicii. Dar există o diferență esențială între expresiile umane și tehnologice ale empatiei, potrivit lui Pinto-Powell.

Factorul „critic

Empatia cognitivă este o înțelegere a suferinței unei persoane, în timp ce empatia afectivă vă permite să simțiți suferința ei, a spus ea. Empatia clinică duce empatia afectivă un pas mai departe, motivând un medic să facă ceva în legătură cu suferința unei persoane.

Inteligența artificială nu va fi niciodată capabilă să înțeleagă empatia afectivă sau clinică, a spus Pinto-Powell, „și cred că empatia clinică este esențială“. Prin urmare, ea este de acord cu concluziile studiului BMJ, conform cărora inteligența artificială nu-i va lua locul de muncă prea curând.

Când medicii văd că ChatGPT îi depășește, tind să se îngrijoreze. Dar când Pinto-Powell analizează cererile de înscriere la școala de medicină, ea nu caută scoruri MCAT mari; ea caută efort, serviciu, muncă clinică, capacitate de îndrumare - și AI nu are nicio șansă împotriva solicitanților cărora le pasă profund de oameni. „Luați un student strălucit care crede că le știe pe toate... Nu-l vreau“, a spus ea. „Acesta este cel mai mortal tip de student pe care trebuie să îl ai“.

Alexis Kayser este redactor pentru sănătate la Newsweek. Contactați-o la a.kayser@newsweek.com